DeepSeek-R1 (Lokales LLM) ist eines der führenden Modelle (aus China), das viel Aufsehen erregt hat – insbesondere für Logik-, Mathematik- und Programmieraufgaben. Es ist so leistungsstark, dass es (mit Einschränkungen) mit Lösungen von OpenAI „konkurrieren“ kann, lässt sich aber lokal , ohne Internet , ohne Abonnements und unter voller Kontrolle des Nutzers betreiben.

Warum ist das cool?

- Alle Daten bleiben bei Ihnen – keine Drittanbieter erhalten Zugriff auf Ihre Anfragen.

- Lokales LLM Ausführung spart Kosten für Cloud-Dienste.

- Das Modell löst komplexe Aufgaben auf professionellem Niveau.

In diesem Artikel erfahren Sie:

- Welche Hardware für DeepSeek-R1 benötigt wird.

- Unterschiede zwischen lokaler und serverbasierter Ausführung.

- Mögliche Anwendungsbereiche und Vorteile des Modells.

- Tipps zu Sicherheit und Privatsphäre bei der KI-Nutzung.

Diese Anleitung erklärt, wie Sie DeepSeek-R1 Q8 Lokales LLM einrichten, ohne Qualität oder Leistung durch Distillation oder reduzierte Quantisierung zu verlieren. Die Gesamtkosten betragen ca. 6.000 $ , inkl. Links zu Komponenten und detaillierten Schritten.

Hardware-Anforderungen

Für DeepSeek-R1 (Modellgröße: 650 GB) mit Q8-Quantisierung ist ein System mit hoher Speicherkapazität , Bandbreite und CPU-Leistung erforderlich.

Komponentenliste (Beispiele aus Foren, ähnliche Teile finden Sie bei Retailern wie Newegg oder Cyberport):

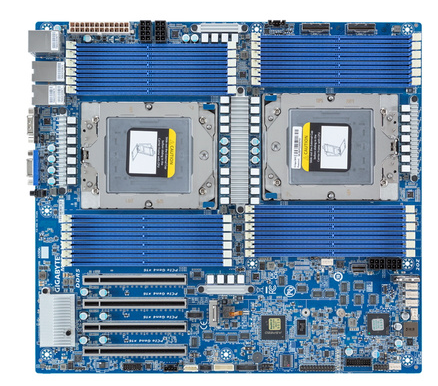

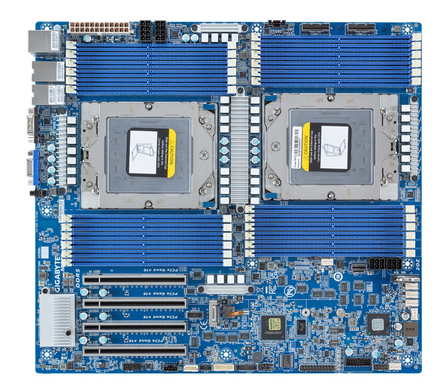

1. Mainboard

- Modell: Gigabyte MZ73-LM0 oder MZ73-LM1

- Grund: Unterstützt zwei AMD EPYC-Sockel und 24 DDR5-Speicherkanäle für maximale Bandbreite. 🔗 Gigabyte MZ73-LM0/MZ73-LM1

2. Prozessoren (CPU)

- Modell: 2x AMD EPYC 9004/9005 (z. B. EPYC 9115 oder 9015 für Kosteneinsparungen).

- Grund: Die Inferenz großer Sprachmodelle (LLM) wird durch Speicherbandbreite limitiert, nicht durch die CPU-Leistung. Budget-Optionen wie der 9115 oder 9015 reichen aus. 🔗 AMD EPYC 9115

3. Arbeitsspeicher (RAM)

- Anforderung: 768 GB über 24 DDR5-RDIMM-Kanäle .

- Konfiguration: 24 Module à 32 GB DDR5 RDIMM für maximale Bandbreite.

- Beispiele: Micron ECC RDIMM DDR5 (32 GB)

4. Gehäuse

- Modell: Enthoo Pro 2 Server Edition (oder vergleichbar).

- Grund: Muss Server-Mainboards unterstützen und ausreichend Kühlung bieten. 🔗 PHANTEKS Enthoo Pro 2 Server Big-Tower, XL-EEB, Tempered Glass – schwarz

5. Netzteil (PSU)

- Modell: be quiet! Pure Power 12 M 1000W ATX 3.1 (1000 W, modular).🔗

- Grund: Liefert genug Leistung für zwei CPUs und inklusive aller benötigten Kabel. 🔗

6. Kühlsystem

- Modell: SP5-kompatibler Kühler für AMD EPYC.

- Empfehlung: Dynatron AMD CPU Kühler J10

- Zusatzlüfter: Ersetzen Sie die Lüfter durch Noctua NF-A12x25 PWM für geringere Geräusche. 🔗 Noctua NF-A12x25 PWM

7. SSD

- Anforderung: 1 TB (oder mehr) NVMe SSD .

- Grund: Schnelle Ladezeiten für die 700 GB Modellgewichte . 🔗 Beispiel-SSDs

Software-Einrichtung

Nach der Hardware folgt die Konfiguration der Software für DeepSeek-R1 Q8 .

1. Installation von llama.cpp

llama.cpp ist ein Framework für lokales LLM-Inferenz.

- Anleitung: Folgen Sie dem GitHub-Repository. 🔗 llama.cpp GitHub

2. Herunterladen des DeepSeek-R1-Modells

- Größe: 650 GB (Q8-Quantisierung).

- Quelle: Hugging Face.

- Download: Laden Sie alle Dateien aus dem Ordner Q8_0 herunter. 🔗 DeepSeek-R1 GGUF-Dateien

3. Modellstart

Testen Sie mit diesem Befehl:

llama-cli -m ./DeepSeek-R1.Q8_0-00001-of-00015.gguf --temp 0.6 -no-cnv -c 16384 -p "<|User|>How many Rs are there in strawberry?<|Assistant|>"

- Erwartetes Ergebnis: Echtzeit-Antwort des Modells als Leistungsnachweis.

Leistung & Optimierung

Leistung

- Generierungsgeschwindigkeit: 6–8 Token/Sekunde (abhängig von CPU und RAM).

- Kontextlänge: Mit 768 GB RAM sind 100.000 Token möglich.

GPU-Nutzung (optional)

- Hinweis:Q8-Quantisierung: Benötigt 700 GB VRAM (Kosten: ~100 000 $). Teilladung: Laden Sie z. B. 300 GB auf die GPU, um die Inferenz zu beschleunigen (weniger bietet kaum Vorteile gegenüber CPU).

Gesamtkosten – ca. € 6595,2

Fazit

Mit diesem Setup können Sie DeepSeek-R1 Q8 lokales LLM ausführen und state-of-the-art LLM-Leistung ohne Cloud oder teure GPUs erreichen. Das System ist für Speicherbandbreite und Kapazität optimiert, um selbst große Modelle effizient zu betreiben.

Brauchen Sie ein lokales LLM? – Rufen Sie uns an!